SXSW 2022’nin ana tema ve trendlerinden birisi dezenformasyon. Geçmiş yıllarda bu konuda post-truth, siyaset, topluma etkisi üzerinden konuşulurken bu yıl açıkça platformlar ve onların dezenformasyonla başa çıkma pratikleri üzerinden tartışılıyor. Rohit Bhargava 2022’nin 10 megatrendinden bahsederken Facebook’tan, dikkat ekonomisinden ve bunu kazanca dönüştürmesinden bahsediyor.

Check My Ads ekibi aşırı sağ eksenden dezenformasyon üreten yayınları engellemek için dezenformasyon, korku, etkileşim ve reklam geliri akışını inceliyor. Sonraki adımda reklam modellerini sorguluyor ve reklamverenleri harekete geçiriyor. Bu kez ise içeriden bir isim deneyimleriyle Facebook’taki dezenformasyonu engellemek için kullanılan yöntemleri ve neden bunların yetersiz olduğunu anlattı. Dezenformasyonun yayılması için ve bunun reklam sektörü ile ilişkisini yakından anlamak için Check My Ads oturumuna göz atmanızı tavsiye ederim. Bu iki yazı da aynı konuya odaklandığı için terimlerin ve pratiklerin anlaşılması için daha iyi bir zemin sağlıyor.

Geçmişte Google ve Pinterest’te çalışan Frances Haugen kamuoyu tarafından 2021’de kamuoyuyla paylaştığı binlerce sayfalık Facebook dokümanlarıyla ve ABD Senatosu’na karşı verdiği ifade ile tanınıyor. Facebook Files veya Facebook Papers olarak olay ile birlikte Facebook’un dezenformasyon konusundaki tutumları, attığı ve atmadığı adımlar yeniden gündem yaratmış ve platformun güvenilirliği bir kez daha sorgulanmıştı.

Sansür kamuoyunu güvende tutmanın doğru yolu değil

Facebook’taki dezenformasyon sorunu ve gerçekliği içeriklerin sansürlenmesi veya kaldırılmasıyla çözülebilecek bir konu değil. Sistemin ve değerlerin gözden geçirilmesi gerekiyor. Frances Haugen, Facebook’un sansüre başvurmadan kullanıcılarını nasıl güvende tutabileceğini bildiğini fakat bu haliyle daha fazla gelir elde ettiği için bunu yapmayı tercih etmediğini söylüyor.

- Yapay zeka ile içerik sansürü yetersiz ve etkisiz.

- Yapay zeka ile içerik sansürü dünyadaki çeşitliliğe göre ölçeklenemiyor.

- Yapay zeka ile içerik sansürü ifade özgürlüğünü gerçekten koruyacak doğru çözümlerin üretilmesini engelliyor.

Yapay zeka ile içerik sansürü yetersiz ve etkisiz

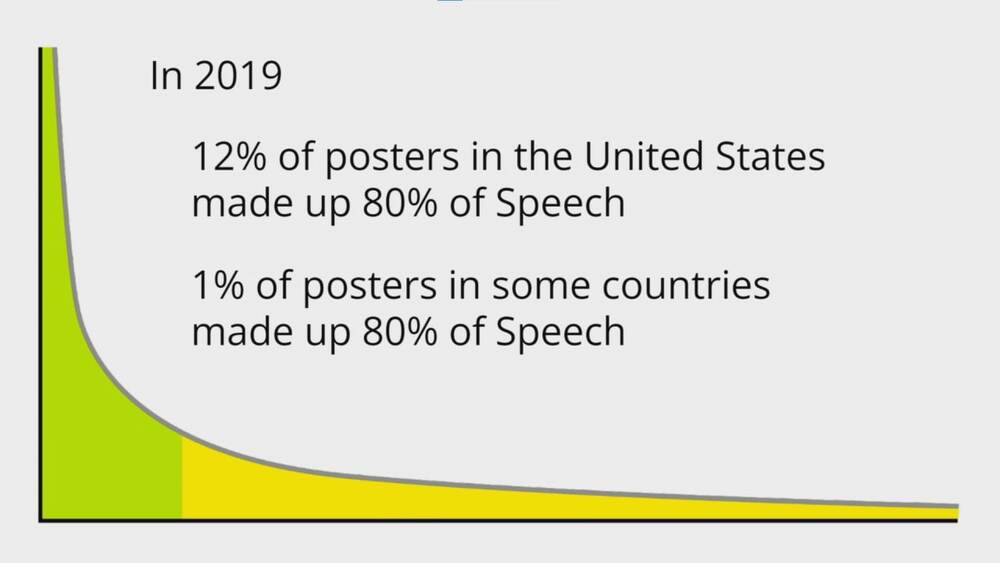

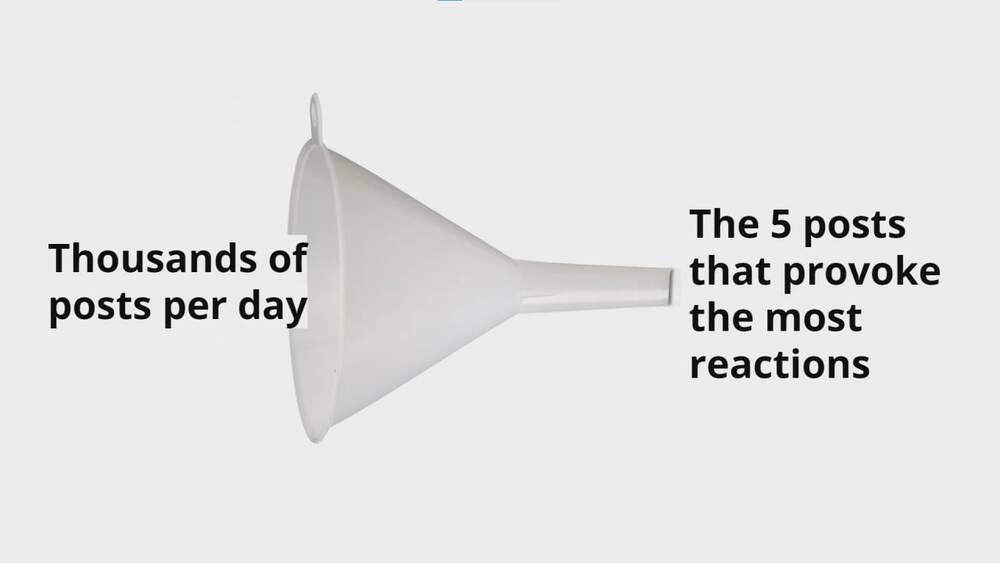

2019’da Facebook’taki içerikler incelendiğinde ABD özelinde paylaşım yapanların %12’si platformdaki toplam dialogun %80’inini oluşturuyor. Dünyada ise paylaşım yapanların %1 toplam dialogun %80’inini oluşturuyor. Bu durum büyük bir gürültü yaratıyor ve Facebook’un hangi içerikleri öne çıkarıp çıkarmadığı konusunda güçlü bir fikir veriyor. Facebook, işleyiş biçimlerini kamu ile paylaşmayan, halka arz edilmemiş özel bir şirket. Bu nedenle Google veya YouTube algoritması gibi hareketleri incelenip değerlendirilemiyor. Anlamlandırılamayan her şey “algoritma” kelimesinin arkasına saklanıyor.

Facebook’un tüm işleyişi size etkileşime girdiğiniz içerikten daha fazla göstermek üzerine kurulu. Eğer sizi öfkelendiren ve bu şekilde harekete geçiren bir içerikle karşılaştıysanız bu da şirket için bir kazanç. Günün sonunda etkileşim yaratıyorlar. Aynı yöntem reklam yayınları için uygulanıyor. Eğer politik bir reklam tepki çekerse ve fazla etkileşim alırsa platform bu tip reklamları yayın ücretleri düşürerek ödüllendiriyor.

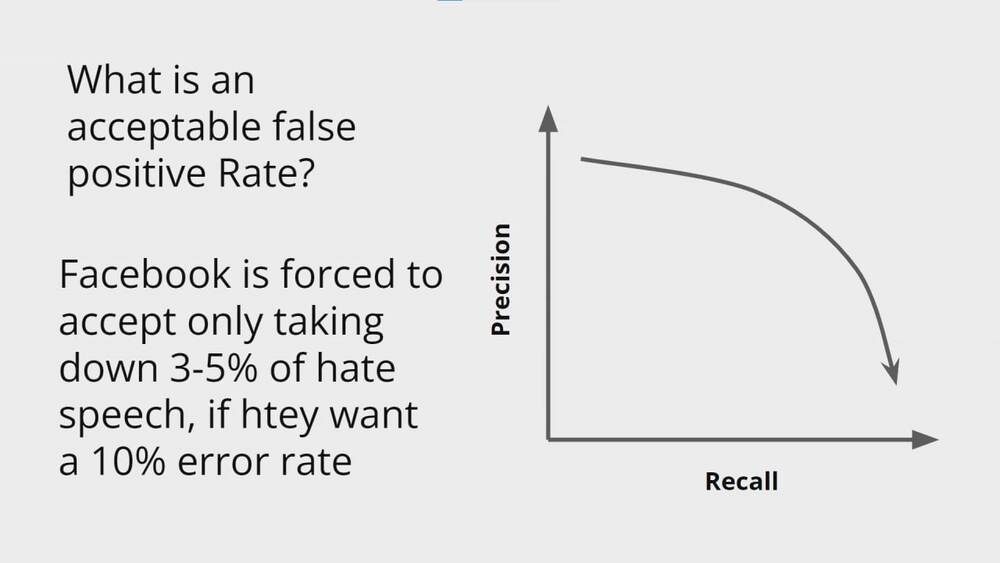

Reklam yayınları ile güçlenen dezenformasyon üreten yalan haberlerin silinmesi ve sansürlenmesi için Facebook’un geliştirdiği yapay zeka yeterli olmadığında 3. parti doğrulama platformları ile birlikte çalışacağını ve bunun önüne geçeceğini duyurmuştu. Ancak burada da platforma gelir yaratan içeriklerin önünü kesmemek için gerçek insanların gerçekleştireceği moderasyonu yayından 3 gün sonra gerçekleştiriyorlar. Yani içerik zaten ulaşması gereken herkese ulaştıktan ve erişimi düşmeye başladıktan sonra. Bu noktada da erişimi %100 azaltmak yerine %3-5 oranında düşürüyor.

Yapay zeka ile içerik sansürü dünyadaki çeşitliliğe göre ölçeklenemiyor

Facebook’un yalan habere ve dezenformasyona karşı geliştirdiği yapay zekası, kelime analizi, erişim kısıtlaması ve 3. parti doğrulama platfomlarını devreye sokması İngilizce başta olmak üzere sadece belirli dillerde varolabiliyor. İçerik üzerinden denetim yapıldığında sadece o içerik üzerinde karar alınıyor fakat sistem değişmiyor. Bu dezenformasyonu yaratan mekanikler ortadan kalkmıyor. Ve bu mekanikler sadece belirli dillerde uygulanıyor. Fakat 50’den fazla dilde hizmet veren Facebook, bu dillerin tamamında aynı eforu ortaya koymuyor.

Ve tabii unutulmaması gereken bir faktör de Kuzey Amerika ve Avrupa’da Facebook opsiyonel kullanılan bir mecra iken Etiyopya veya Myanmar gibi ülkelerde internete erişmek için doğrudan Facebook’a bağlanmak ve kullanmak gerekiyor. Bu ülkelerde internetin kontrolü Facebook’un elinde. Facebook ve dezenformasyon ikilisinin Etiyopya’da yarattığı sonuçlar için The New York Times, The New York Times ve The Guardian bağlantılarını; Myanmar içinse NBC News ve Global Witness bağlantılarını ziyaret edebilirsiniz.

Yapay zeka ile içerik sansürü ifade özgürlüğünü gerçekten koruyacak çözümlerin üretilmesini engelliyor

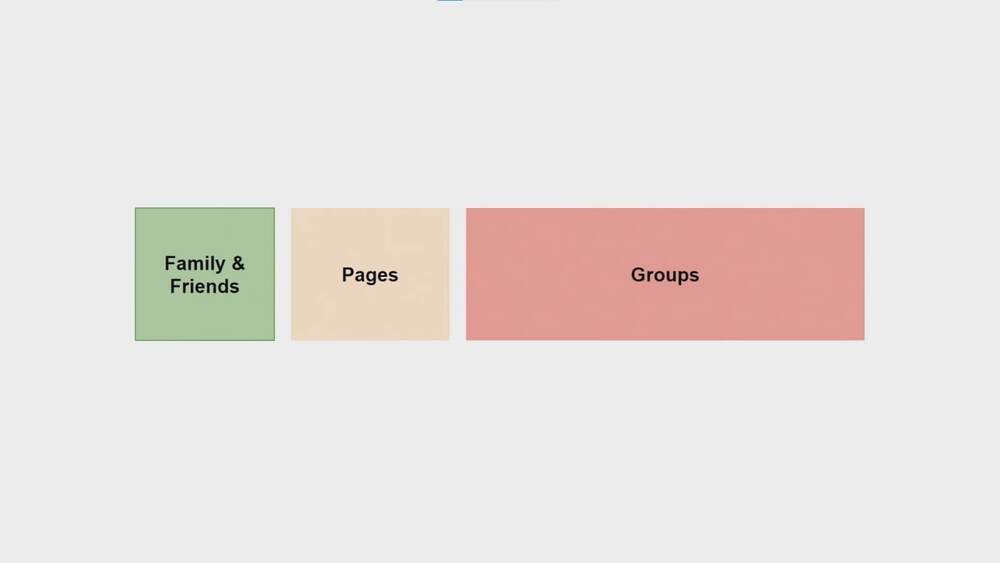

2008’de Facebook bambaşka bir yerdi. Aile ve yakınlarımızla bir araya geldiğimiz onlarla etkileşime girdiğimiz bir alandı. Fakat hissedarlara karşı sorumlulukları olan ve sürekli büyümesi gereken Facebook farklı ürünler geliştirerek platformdaki etkileşimi artırmanın yollarını aramaya başladı. Bu noktada Grup ve Sayfa fonksiyonlarını hayata geçirdi. Agresif şekilde kullanıcılarına sayfalar önerdi, gruplara katılmasını önerdi. Daha fazla gruba girmeye, burada aktif olmaya teşvik etti.

Aradan seneler geçti; 2015 ve sonrasında Facebook Grupları dezenformasyonun üretildiği ve güçlü şekilde yayıldığı alanlara dönüştü. Kullanıcılar günde 20 bin kişiyi gruplara davet edebiliyor. Gruba girmek için kullanıcının bir onay vermesi istenmiyordu. Bir başkası eklendiğinde otomatik olarak gruba giriyordunuz. Böylece grupları çok fazla büyüdü ve genişedi. Bunu, bir içeriğin birden fazla yerde aynı anda paylaşılmasını sağlayan özellikler takip etti. Artık hakikat dışı makaleler anında milyonlara ulaşabiliyor ve etkileşim alabiliyordu.

Bu etkileşim akıntısı içinde Facebook’a bildirilen içerikler önce yapay zeka ardından gerçek insanlar tarafından inceleniyor ve değerlendiriliyordu. Fakat sayısız şiddet ve tetikleyici görüntü içeren içeriğe maruz kalan moderatörler başta travma sonrası stres bozukluğu olmak üzere çeşitli travma ve mental hastalıklar ile başa çıkmak zorunda kaldı. Moderatörlerin yaşadıkları için detaylı okumalı bu bağlantıları üzerinden yapabilirsiniz; The Verge; The Verge, BBC, The Washington Post, Vice.

Sansürü değil platformu ve mekanizmayı düşünmeliyiz

Frances Haugen’e göre çözüm çok basit ancak bunu yapmaya istekli olacak bir Facebook’a ihtiyaç var. Gelir modelini, nefret söylemine bağlı etkileşimini bir kenara koyacak bir Facebook gerekiyor. Sansürü değerlendirdikçe sadece görebildiğimiz kadarını düzenlemeye çalışıyoruz ve Etiyopya, Myanmar gibi ülkelerde yaşananları göz ardı ediyoruz.

Bu değişimi tetikleyebilecek destekleyici yöntem de internetteki makalelere denk geldiğimizde içeriği paylaşmak için Twitter’da olduğu gibi paylaşıma ekstra bir buton, menü eklemek ve sürtünmeyi artırmak. Twitter’daki bu ekstra işlem sayesinde %10-50 arasında düşüş yaşanıyor. Doğrudan karşılaştığımız içeriği yeniden paylaşmak, bir kaç basamakta tanımadığımız insanlara bu içeriğin ulaşmasını mümkün kılıyor. Fakat o içerik paylaşılmadan önce kullanıcının düşünebileceği bir alan yarattığımızda doğrudan 3. parti doğrulama mekanizması haline geliyor.

Frances Haugen sunumunu Mark Zuckerberg ne zaman dezenformasyona karşı olduğunu dile getirse içinin acıdığını çünkü yapabilecek sistemi ve gücü olduğunu fakat mevcut sistem daha karlı olduğu için yapmamayı seçtiğini hatırlatarak bitirdi.

Görsel: SXSW, Glen Carrie on Unsplash

![Facebook’un Uyguladığı Sansür Hakkında 3 Gerçek [SXSW 2022]](https://bigumigu.com/wp-content/uploads/2022/03/Frances_Haugen_facebook_sxsw_2022_bigumigu_22-1300x680.jpg)